メモリの壁を砕く圧縮革命、TurboQuant始動

長文推論を重くする最大の要因は、LLMが持つKVキャッシュのメモリ肥大です。Google Researchの「TurboQuant」は、このボトルネックを正面から崩します。精度を落とさず、少なくとも6倍のメモリ削減。しかも、高速化まで手に入るという報告です。

もしこの効率が当たり前になれば、同じGPUで扱える文脈は大きく伸びます。ローカルAIも現実的になり、検索・推薦の基盤も軽くなります。コストは下がり、体験は上がる。そんな転換点の合図が、TurboQuantです。

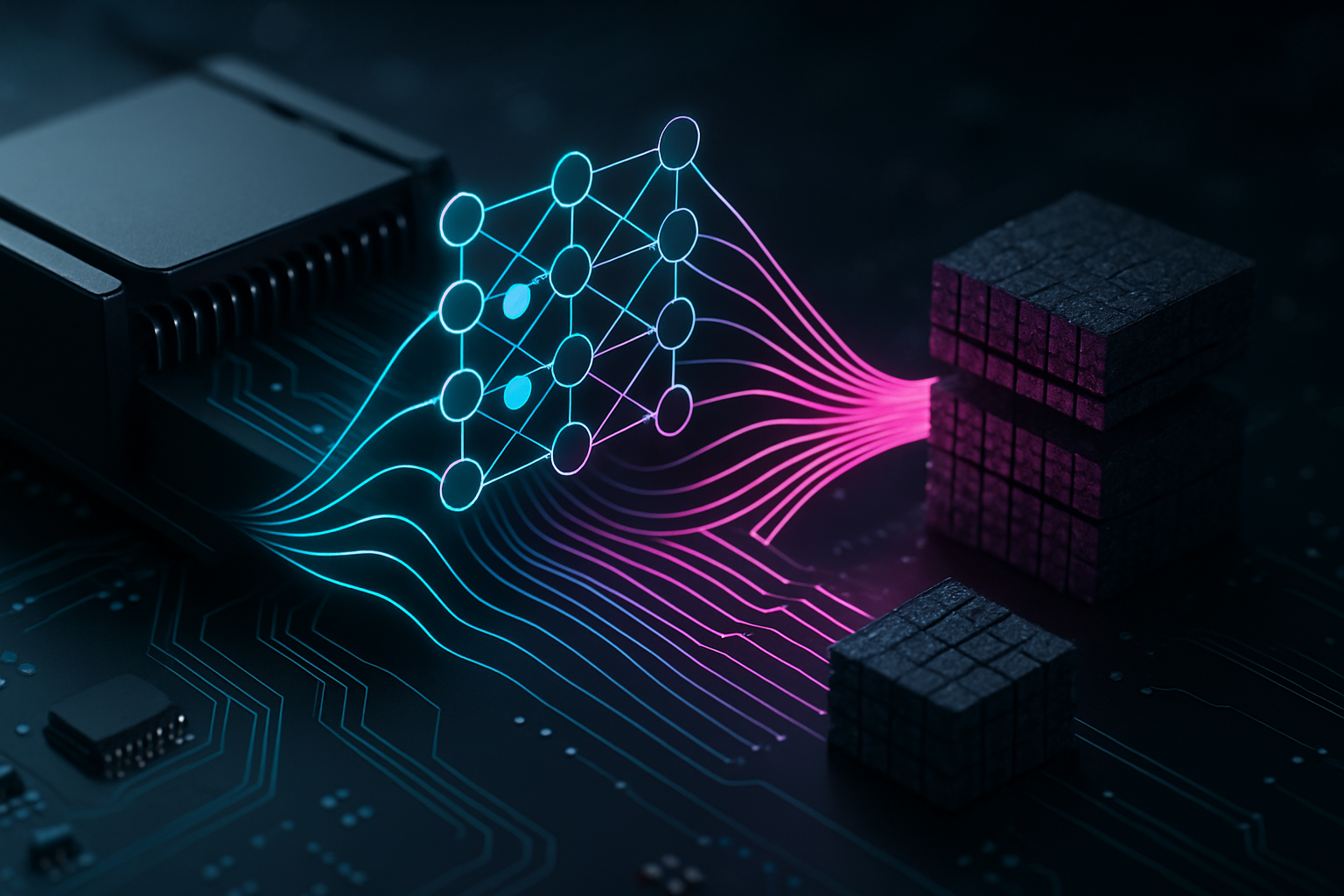

TurboQuantの全体像:何が新しいのか

一言でいうと

TurboQuantは、ベクトル量子化のオーバーヘッドを最小化し、KVキャッシュを3~4ビット級に強圧縮しながら、下流タスクの精度を維持する新手法です。公開情報によれば、公式ブログでICLR 2026採択予定の解説とともに、長文系ベンチマークでの検証が報告されています。

- 対象:LLMの推論時KVキャッシュ、ベクトル検索インデックス

- 効果:KVメモリを少なくとも6倍削減、H100上で最大8倍のアテンション高速化(4bit動作時の比較報告)

- 追加学習不要:事前学習・微調整なしで適用可能とされる点が実運用で効く

- 長文に強い:LongBenchやNeedle-in-a-Haystack等でフル精度相当の結果

また、従来のPQ(Product Quantization)やRabitQと比べても、検索精度(Recall)やドット積歪みで優位だとする検証が示されています(例:ケータイ Watch、ITmedia)。

仕組みをほどく:PolarQuantとQJLの二段圧縮

PolarQuant:量子化の“持ち物”を軽くする

量子化では本体のデータ以外に、スケールやゼロポイントなどメタ情報を持つ必要があり、これが隠れたメモリ負担になります。PolarQuantはデータ表現を極座標系へ回転させ、高品質な量子化を行うことで、追加の持ち物(オーバーヘッド)を最小化します。結果として、「圧縮のための余計なメモリ」を極力削る方向へ設計されています。

イメージとしては、直交座標でバラつく次元を、半径と角度でスッキリ表す変換をかけ、少ないビット幅でも元の距離関係を壊さないように詰める動きです。これが、後段の計算の安定性にも効いてきます。

QJL(Quantized Johnson–Lindenstrauss):残差を1ビットまで凝縮

一次圧縮でわずかに出る誤差(残差)を、ランダム射影の理論であるJohnson–Lindenstraussの補題にもとづき乱択化し、+1/−1のサイン1ビットで訂正します。ここがTurboQuantの肝。「大きな効果を、極小の追記で」実現するため、総メモリが大きく減ります。

この二段構えにより、ドット積の歪みとRecallを最適化しつつ、KVの実使用量を6分の1以下に抑える。ベクトル検索にも転用でき、インデックス構築の前処理すら省けるという報告も見られます(例:XenoSpectrum)。

開発者のための使い方ガイド:LLM推論と検索基盤

適用の考え方

現時点で公式SDKは限定的ですが、適用の勘所は明確です。KVキャッシュを生成・保持する層に量子化フックを差し込み、3〜4ビットを中心に検証します。長文タスクの下流精度とスループット、GPUメモリのピーク使用量を同時に追うのがコツです。

- 用途優先でビット幅を選ぶ:3bitは節約重視、4bitは速度・安定性バランス

- 追加学習なしでA/B:微調整不要の前提を活かし、即座に比較

- 長文系ベンチを採用:LongBench、RULER、ZeroSCROLLSなど

- 検索ならRecall@k:PQやRabitQとの実測比較

導入チェックリスト

- KV管理:vLLM、TensorRT-LLM、llama.cpp等のKV実装点を確認

- I/O最適化:量子化後の帯域・キャッシュヒットを計測

- 監視:レイテンシP95/P99、OOM頻度、メモリ断片化

- フォールバック:要所で非量子化KVに切替可能に

コミュニティ実装の試行も進み始めています。例として、Apple MLXでの実装とQwenでのテストに触れる報告をGIGAZINEが紹介しています。

検証結果とベンチマーク:数字で見るインパクト

Google Researchは、GemmaやMistral、Llama 3.1 8Bなどで、LongBench、Needle-in-a-Haystack、ZeroSCROLLS、RULER、L-Evalといった長文系標準ベンチを実施しています。結果は、KVが6倍以上小さいのに下流性能はフル精度と同等という、にわかに信じがたい良好さです。

“TurboQuant achieves perfect downstream results across all benchmarks while reducing the key value memory size by a factor of at least 6x.”(出典:Google Research)

さらに国内メディアは、学習なし適用とH100で最大8倍高速の検証を次のように伝えています。

「事前のトレーニングや微調整が実行されることなく、KVキャッシュが3ビットまで量子化される。H100 GPU環境での検証では、32ビットの非量子化キーと比較して、4ビットのTurboQuantにより最大8倍の処理高速化が確認されている。」(出典:ケータイ Watch)

ベクトル検索でも、PQやRabitQに対しRecallで優位との報告があり、インデックス構築の前処理を省略できる点は実務で効きます。

実運用インパクト:長文、ローカルAI、検索基盤が変わる

TurboQuantは、コストを横に倒すのではなく、使えるコンテキストを縦に伸ばす技術です。長い会話、数十万〜数百万トークン級の文書、長尺コードの把握など、これまでKVが支配していた領域で自由度が増します。ローカルAIやエッジでも現実的なバジェットで運用しやすくなります。

市場の反応としては、発表直後にメモリ関連株が調整したとの報道もありますが、効率化は需要の総量を押し上げる可能性が高いという見方が複数のメディアで示されています(例:Forbes JAPAN、ビジネス+IT)。ITmediaやZDNET Japanも、推論コスト低下が永続的な利益をもたらす可能性に言及しています。

- 長文処理:同じGPUで扱える文脈長が拡張、RAGのヒット率や要約の質が安定

- ローカルAI:VRAMやRAMの天井が下がり、中〜大規模モデルの選択肢が広がる

- 検索基盤:インデックスの省メモリ・即時構築が可能に

注意点と限界:いま何が言えて、何が言えないか

TurboQuantは強力ですが、すべてが即日で置き換わるわけではありません。TechCrunchは次のように冷静です。

“Still, it’s worth noting that TurboQuant hasn’t yet been deployed broadly; it’s still a lab breakthrough at this time.”(出典:TechCrunch)

実装・最適化はフレームワーク依存で、I/Oやカーネル融合の設計も必要です。学習側のHBM需要を直ちに減らすわけでもありません。まずは推論のKV削減から確実に成果を拾い、長文タスクでの下流KPIを守りながら展開するのが安全です。

- 配備段階:研究〜実装過渡期、互換性と計測が要

- ワークロード差:短文中心では恩恵が相対的に小さい可能性

- 可観測性:KVヒット率、OOM、誤答パターンをダッシュボード化

実装のカタチを想像する:最短ルートの設計図

プロダクションでの展開モデル

まず長文がコアの経路から導入します。RAGの再ランキング、長文QA、法務・製薬ドメインの要約など、KV負荷が高いホットスポットを特定。次に、4bit優先で安定度を確かめ、箇所限定の3bitで限界を攻めます。

- 段階導入:影響が読めるAPIからロールアウト、シャドー運用で回帰監視

- 安全弁:品質しきい値で非量子KVへフォールバック

- SLA設計:P95/P99レイテンシとコンテキスト長SLOを再定義

検索では、量子化インデックスを準リアルタイムで差し替えられる設計に。PQからの移行では、Recall@kの並走比較でビジネスKPIを守ることが重要です。

まとめ:長文時代の“当たり前”を塗り替える

TurboQuantは、KVキャッシュを6倍以上小さくしながら精度を維持し、H100上での最大8倍高速化という現実的な利点を示しました。これは、推論コストを下げ、長文の制約を緩め、ローカルAIを前へ進める技術です。

次の一手はシンプルです。長文ホットスポットを選び、4bit/3bitでA/B。下流KPIが守れる場所から導入し、メモリとレイテンシの“空いた枠”を新しい価値で埋めていきましょう。効率は目的ではなく、より深い体験のための手段です。

参考リンク:Google Research/ケータイ Watch/ITmedia/Forbes JAPAN/TechCrunch

コメント